CPU ها مدتها است که به عنوان سنگ بنای توان محاسباتی در رایانههای شخصی، سرورها و بسیاری از دستگاههای الکترونیکی ایفای نقش مینمایند اما با توجه به روند فزاینده رشد هوش مصنوعی (AI) و پیچیدگی روزافزون پلتفرمهای میزبانی وب، واحدهای پردازش گرافیکی (GPU) به عنوان رقیبی قدرتمند ظهور یافته و سلطه CPU ها را به چالش کشیدهاند.

به طور کلی، مقایسه CPU و GPU در زمینه هوش مصنوعی و میزبانی وب، نشان میدهد که هر یک برای وظایف خاصی بهینهسازی شدهاند. این مقاله با تمرکز بر تقابل آنها، به بررسی نقاط قوت، ضعف و سناریوهای برتر هر دو پردازنده میپردازد تا دیدگاه دقیقتری برای انتخاب زیرساخت مناسب به شما ارائه دهد.

نکات کلیدی این مقاله

با مطالعه این مقاله و مقایسه CPU و GPU، مفاهیم ذیل به شکلی جامعتر درک خواهند شد:

- تفاوتهای معماری و عملکردی قابل توجه در ارزیابی GPU ها و CPU ها

- قابلیتهای چندمنظوره CPU ها

- توان پردازش موازی GPU ها

- حجم کاری هوش مصنوعی و برتری GPU ها

- پلتفرمهای میزبانی وب که همچنان CPUها در آنها ایدهآل تلقی میگردند.

- نوآوری های آینده مرتبط با ترکیب CPU ها و GPU ها

- ترندها و فناوریهای نوظهور

- سناریوهای واقعی کاربرد GPU ها

- درک ارزش هر دو واحد پردازش گرافیکی و مرکزی

آیا برای یک وب سرور به کارت گرافیک نیاز است؟

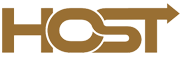

مدیران اپلیکیشن های تحت وب، به طور فزایندهای کارتهای گرافیک GPU را در سرورهای خود اضافه می کنند. آمار و ارقام نیز این واقعیت را تایید می نمایند. هزینه هر هسته در CPU بالاتر و در GPU پایین تر میباشد. با سرمایهگذاری یکسان، میتوان به جای چند هسته CPU، هزاران هسته GPU در اختیار داشت. این امر به خوبی قدرت GPU ها را نمایان میسازد.

مقایسه CPU و GPU: تفاوتهای اصلی در معماری و عملکرد

درک تفاوتهای اساسی معماری برای درک چرایی تناسب GPU ها و CPU ها با وظایف مختلف، ضروری تلقی میگردد. در ادامه، هر یک از این فناوریها به دقت مورد بررسی قرار خواهند گرفت.

تصویر(۱)

CPUها: نیروگاههای چندمنظوره

CPUها به عنوان پردازندههای عمومی طراحی شدهاند که وظایف گوناگون را به صورت کارآمد انجام می دهند. به دلیل منطق کنترل پیچیده و حجم بالای حافظه کش، آنها در وظایفی که نیازمند عملکرد تکرشتهای هستند، برتری دارند. در بحث مقایسه CPU و GPU، نکته کلیدی درون تعداد و نوع هستهها نهفته است؛ CPU های متداول شامل چند هسته (در سرورهای پیشرفته مدرن از ۴ تا ۶۴ هسته) هستند که قادر به اجرای دستورالعملهای متعدد در هر سیکل میباشند. این ویژگی برای فرآیندهایی که به دقت بالا در مجموعهای متنوع از عملیات نیاز دارند، ایدهآل است. CPU مغز هر رایانه یا سرور محسوب میشود. هر سرور اختصاصی با CPU های فیزیکی برای انجام پردازشهای سیستمعامل ارائه خواهد شد. سرورهای VPS نیز دارای هستههای مجازی هستند که توسط یک تراشه فیزیکی تخصیص مییابند.

مقایسه CPU و GPU: تفاوتهای اساسی

در گذشته، چنانچه وظیفهای نیازمند توان پردازشی بالایی بود، به جای افزودن کارت گرافیک یعنی GPU، توان CPU افزایش داده میشد و سیکلهای clock بیشتری از پردازنده، به وظایفی که نیازمند سرعت بالاتر بودند، تخصیص مییافت. بسیاری از سرورهای پایه با ۲ تا ۸ هسته ارائه میشوند و برخی سرورهای قدرتمند دارای ۳۲، ۶۴ یا حتی هستههای پردازشی بیشتری میباشند. هستههای CPU نسبت به GPU، دارای سرعت کلاک بالاتری هستند که معمولا در محدوده ۲ تا ۴ گیگاهرتز قرار میگیرد. سرعت کلاک CPU، یک تفاوت اساسی است که در مقایسه پردازنده با کارت گرافیک باید مورد توجه قرار گیرد.

GPUها: غولهای پردازش موازی

GPU ها که در ابتدا برای رندرینگ گرافیک طراحی شده بودند، شامل هزاران هسته کوچکتر و سادهتر میباشند که برای پردازش موازی طراحی شدهاند. این معماری به GPU ها امکان میدهد تا وظایف متعدد را همزمان مدیریت کنند و آنها را برای عملیات های موازی، بسیار کارآمد سازند. در حالی که CPU ممکن است در وظایف ترتیبی برتری داشته باشد اما معماری GPU در سناریوهایی که نیازمند موازیسازی گسترده هستند، می درخشد. GPU نوعی تراشه پردازنده می باشد که به طور خاص برای استفاده در کارت گرافیک طراحی شده است. GPU هایی که به طور خاص برای طراحی و صفحه نمایش رایانه استفاده نمیشوند، مانند آنهایی که در سرورها قرار دارند، گاهی اوقات به عنوان General Purpose GPUs یا (GPGPU) شناخته میشوند.

مقایسه CPU و GPU: تفاوتهای آنها

سرعت clock یک GPU ممکن است از CPU های مدرن پایینتر باشد اما تعداد هستهها در هر تراشه بسیار بیشتر می باشند. در واقع، اصلیترین محور برای مقایسه CPU و GPU همین تفاوت در چیدمان هستهها خواهد بود؛ این ویژگی به GPU کمک میکند تا بسیاری از وظایف پایه را همزمان (Parallel) انجام دهد. علاوه بر این، سرعت هسته کارتهای گرافیک به طور پیوسته در حال افزایش است اما به طور کلی در مقایسه با CPU، پایینتر میباشد.

چرا کل سیستمعامل نمیتواند روی GPU اجرا شود؟

برای استفاده از کارت گرافیک به جای CPU، محدودیتهایی وجود دارد. یکی از محدودیتهای اصلی این است که تمامی هستههای GPU تنها برای پردازش یک عملیات مشابه به طور همزمان طراحی شدهاند و تحت عنوان Single Instruction Multiple Data یا به اختصار (SIMD) شناخته میشود. بنابراین اگر ۱۰۰۰ محاسبه مشابه یکتا، مانند شکستن هش رمز عبور انجام گیرد، GPU میتواند با اجرای آنها به صورت یک رشته روی هسته خود، عملکرد بسیار خوبی داشته باشد. با این حال برای عملیات های مبتنی بر هسته، کارت گرافیک نسبت به CPU (مانند نوشتن فایلها روی دیسک یا کنترل وضعیت های مختلف سیستم) بسیار کندتر خواهد بود.

GPU ها به دلیل سرعت کمتر و وجود پردازشگرهای بیشتر بین آن و Memory، در مقایسه با CPU تاخیر عملیاتی (operational latency) بیشتری دارند. مدت زمان انتقال و واکنش CPU ها کمتر و بهتر است زیرا برای سرعت بالا در دستورالعملهای واحد طراحی شده اند. در مقایسه با تاخیر، GPU ها برای پهنای باند بیشتر تنظیم شدهاند که دلیل دیگری مبنی بر مناسب بودن آنها جهت پردازش موازی گسترده محسوب میشود. از نظر عملکرد، GPU ها برای انجام محاسبات سریع تک بعدی که مختص CPU ها می باشد، طراحی نشدهاند.

آیا GPU و CPU میتوانند با یکدیگر کار کنند؟

در سیستم، سوئیچی وجود ندارد که بتوان آن را روشن کرد تا به عنوان مثال، ۱۰ درصد از کل محاسبات به کارت گرافیک منتقل شود. در واقع، هنگام مقایسه CPU و GPU از نظر پیادهسازی، متوجه خواهید شد که در پردازشهای موازی، جایی که دستورات میتوانند برای محاسبه به GPU منتقل گردند، دستورالعملهای لازم برای این کار باید به صورت hard-coded در برنامه مرتبط گنجانده شوند. خوشبختانه، تولیدکنندگان کارت گرافیک مانند NVIDIA و توسعهدهندگان متنباز، کتابخانههای رایگان NVIDIA CUDA-X را برای استفاده در زبانهای برنامهنویسی رایج مانند ++C یا پایتون ارائه میدهند که برنامه نویسان میتوانند آنها را جهت بهرهگیری برنامههای خود از پردازش GPU در صورت موجود بودن، استفاده کنند.

حجم کاری هوش مصنوعی و سلطه GPU ها

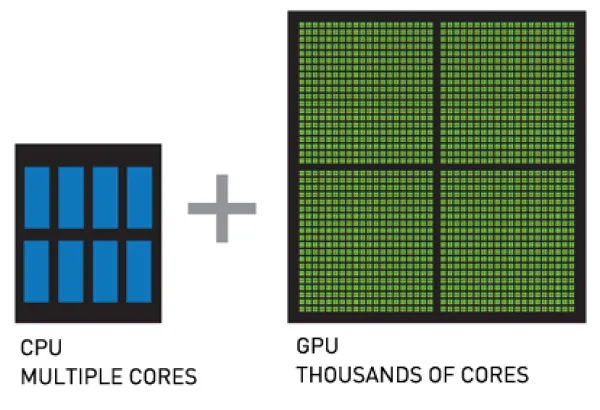

هوش مصنوعی، به ویژه یادگیری ماشین (ML) و یادگیری عمیق، حوزه های متعددی را متحول ساخته است. مؤلفه اصلی یادگیری عمیق، یعنی آموزش شبکه عصبی، شامل انجام میلیونها عملیات ضرب ماتریس میشود، وظیفهای که به خوبی با معماری موازی GPU ها سازگار می باشد.

تصویر(۲)

۱. آموزش شبکههای عصبی

آموزش یک شبکه عصبی عمیق شامل تنظیم میلیونها پارامتر از طریق تکنیکهایی مانند Backpropagation میباشد. Backpropagation روشی است که برای آموزش شبکههای عصبی به کار گرفته میشود و مشابه نحوه آموزش یک کودک از طریق تصحیح اشتباهات می باشد. نحوه عملکرد آن به شرح زیر است:

- حرکت رو به جلو (Forward Pass): دادهها لایه به لایه از شبکه عبور میکنند تا زمانی که خروجی تولید شود. این خروجی با پاسخ واقعی مقایسه شده و تفاوت (خطا) محاسبه میگردد.

- حرکت رو به عقب (Backward Pass): سپس شبکه به عقب بازمیگردد تا میزان سهم هر اتصال (وزن) در خطا را تعیین کند. وزنها جهت کاهش خطا، به میزان اندکی تنظیم میشوند. این فرآیند بارها تکرار شده و به تدریج دقت شبکه بهبود مییابد.

این فرآیند از نظر محاسباتی فشرده بوده و شامل تعداد قابل توجهی از وظایف با قابلیت موازیسازی میباشد. GPU ها قادر به مدیریت همزمان این عملیات در هزاران هسته خود هستند که زمان موردنیاز برای آموزش را به شدت کاهش میدهد. به عنوان مثال، سری Tesla از NVIDIA و Radeon Instinct ساخت AMD، برای وظایف هوش مصنوعی و یادگیری عمیق طراحی شدهاند. این GPU ها توان محاسباتی عظیمی را فراهم میکنند و فرآیندهای آموزشی را در مقایسه با CPU ها به طور چشمگیری تسریع میبخشند.

۲. استنتاج (Inference): محیطی متعادلتر

در حالی که GPU ها جهت آموزش مدلها برتری دارند، استنتاج (فرآیند پیشبینی با استفاده از یک مدل آموزشدیده) میتواند به طور موثر توسط هر دو CPU و GPU مدیریت شود. مقایسه CPU و GPU در این مرحله نشان میدهد که انتخاب گزینه برتر به الزامات خاص پروژه بستگی دارد. CPU ها احتمالا برای استنتاج آنی که در آن تاخیر پایین حیاتی است، به دلیل عملکرد تکرشتهای بهتر، مزیت بیشتری داشته باشند. در عین حال، GPU ها همچنان برای وظایف استنتاج با پردازش دستهای، برتری قابل توجهی دارند.

۳. اکوسیستم نرمافزاری

اکوسیستم هوش مصنوعی نیز به شدت برای GPU ها بهینهسازی شده است. فریم ورکهایی مانند TensorFlow ،PyTorch و CUDA برای بهرهبرداری از توان پردازش موازی GPU ها طراحی شدهاند. این گونه فریم ورکها، کتابخانهها و ابزارهایی را فراهم میکنند که استقرار و بهینهسازی مدلها روی سختافزار GPU را برای توسعهدهندگان آسانتر میسازند و بدین ترتیب، سلطه GPU ها در هوش مصنوعی را بیش از پیش تثبیت مینماید.

پلتفرمهای میزبانی وب: قلمرو CPU ها

پلتفرمهای میزبانی وب، به عنوان ستون فقرات اینترنت، مبتنی بر CPU ها هستند که این امر ناشی از توانایی آنها در انجام همزمان طیف وسیعی از وظایف است.

۱. مدیریت حجمهای کاری متنوع

وب سرورها وظایف متعددی از جمله پردازش درخواستهای HTTP، اجرای منطق برنامه و تعامل با پایگاههای داده را مدیریت میکنند. این وظایف ممکن است نیازمند رشته هایی با بازدهی بالا و قابلیت مدیریت حجمهای کاری متنوع و غالبا غیرقابل پیشبینی باشند؛ حوزههایی که CPU ها در آنها برتری دارند. به عنوان مثال، ارائه محتوای وب متحرک و پویا، شامل اجرای اسکریپتهای سمت سرور (مانند PHP، پایتون، روبی) میشود که از توانایی CPU در جابجایی سریع بین وظایف و مدیریت منطق پیچیده، بهرهمند میگردند.

۲. مجازیسازی و کانتینریسازی

میزبانی وب مدرن به شدت بر فناوریهای مجازیسازی و کانتینری سازی مانند VMware، Kernel-Based Virtual Machine (KVM)، Docker و Kubernetes متکی است. این فناوریها محیطهای ایزوله برای اجرای برنامهها ایجاد میکنند که امکان بهرهوری بهتر از منابع و مقیاسپذیری را فراهم میآورند. CPU ها، با پشتیبانی قوی خود از مجازیسازی و مجموعه دستورالعملهای پیشرفته، برای این وظایف بسیار مناسب میباشند. آنها قابلیتهای لازم برای مدیریت کارآمد ماشینهای مجازی و کانتینرها را فراهم کرده و از تخصیص و استفاده مؤثر منابع اطمینان حاصل میکنند.

۳. مقیاسپذیری و افزونگی

CPU ها نقش حیاتی در مقیاسپذیری اپلیکیشن های تحت وب ایفا میکنند. در مبحث مقایسه CPU و GPU برای زیرساختهای شبکه، باید به این نکته توجه داشت که توزیعکنندههای بار (Load balancers) که ترافیک ورودی وب را بین چندین سرور تقسیم میکنند، برای مدیریت کارآمد ترافیک شبکه و اطمینان از تاخیر پایین، نیازمند بازدهی بالا در هر رشته (Single-thread) میباشند. علاوه بر این، پلتفرمهای میزبانی وب اغلب از CPU ها برای مدیریت مکانیزمهای افزونگی و Failover استفاده میکنند که دسترسی پذیری بالا و قابلیت اطمینان خدمات وب را فراهم میآورند.

۴. رایانش لبه (Edge Computing)

رایانش لبه که ذخیرهسازی و محاسبات داده را به محل موردنیاز نزدیکتر میکند، غالباً به CPUها متکی می باشد. این وابستگی از آن جهت است که دستگاههای لبه مانند روترها یا سرورهای اختصاصی، قابلیتهای پردازشی چندمنظوره را برای مدیریت وظایف مختلف به صورت محلی نیاز دارند. معماری عمومی آنها باعث میشود که CPU ها برای این حجمهای کاری ناهمگون و اغلب حساس به تأخیر، مناسبتر باشند.

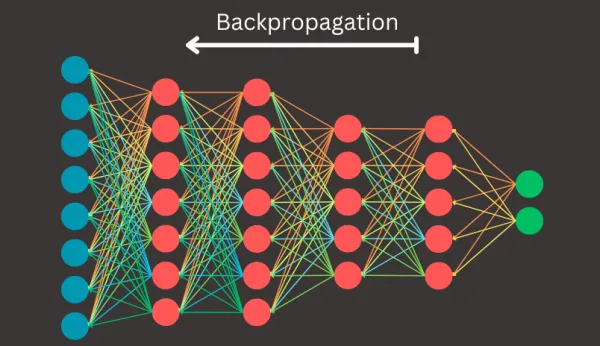

پتانسیل همافزایی: ترکیب CPU ها و GPU ها

در حالی که GPU ها و CPU ها هر یک مزایای متمایزی دارند، قدرتمندترین سیستمها اغلب هر دو قابلیت را با هم ترکیب میکنند. این همافزایی در بسیاری از سناریوهای پیشرفته محاسباتی، مانند هوش مصنوعی و پلتفرمهای میزبانی وب با بازدهی بالا، مشهود است.

تصویر(۳)

زیرساختهای مدرن هوش مصنوعی بر پایه تعامل بهینه میان CPU (برای مدیریت، پیشپردازش و تحلیل نهایی) و GPU (جهت محاسبات موازی سنگین) استوار می باشد که این همافزایی در قالب سرویسهای ابری ترکیبی و پلتفرمهای هماهنگسازی کانتینر مانند کوبرنتیز، نمود پیدا کرده است؛ این رویکرد به توسعهدهندگان اجازه میدهد تا حجمهای کاری پیچیده هوش مصنوعی و تحلیلهای آنی را بهصورت یکپارچه و مقیاسپذیر در کنار زیرساختهای معمول وب مستقر کرده و از توان هر دو پردازنده برای بهینهسازی عملکرد بهره ببرند.

آینده: ترندها و فناوریهای نوظهور

پیشرفتهای اخیر در سختافزار و نرمافزار با معرفی CPU های بهینهشده برای هوش مصنوعی و فناوریهایی نظیر GPUDirect و حافظه یکپارچه، مرزهای سنتی در مقایسه CPU و GPU را کمرنگ کرده و کارایی انتقال داده را به شدت افزایش دادهاند؛ علاوه بر این، ادغام سختافزارهای تخصصی مانند ASIC و FPGA در کنار ظهور پتانسیلهای رایانش کوانتومی، اکوسیستمی مکمل ایجاد کرده که با کاهش تأخیر و افزایش سرعت وظایف پیچیده، افقهای جدیدی را در محاسبات سنگین و هوش مصنوعی گشوده است.

سناریوهای واقعی که GPU ها در آنها قدرتمند هستند

در ابتدای این مقاله، سوالی مطرح شد که “آیا برای یک وب سرور به کارت گرافیک نیاز است؟” اگر بله، چرا؟ برای افرادی که به دنبال پاسخ هستند، باید گفت که این امر کاملا وابسته به شرایط می باشد. در اکثر موارد، سرور فاقد مانیتور است اما کارتهای گرافیک میتوانند برای وظایفی غیر از صفحه نمایش نیز به کار گرفته شوند. کاربرد GPU ها در رایانش، هر نوع پردازش ریاضی فشرده و عمومی است. در ادامه به چند مثال کلاسیک اشاره میشود:

- تاخوردگی زنجیره پروتئین و مدلسازی عناصر

- شبیهسازیهای اقلیمی، مانند پردازش لرزهنگاری یا پیشبینی طوفان

- فیزیک پلاسما

- تحلیل سازه

- یادگیری عمیق ماشین برای هوش مصنوعی.

یکی از مشهورترین کاربردهای کارتهای گرافیک، استخراج ارزهای دیجیتال مانند بیتکوین میباشد.

تصویر(۴)

این فرآیند اساسا تعداد زیادی عملیات ممیز شناور را برای رمزگشایی یک بلوک از تراکنشها انجام میدهد. اولین ماشینی که راهحل صحیح را پیدا کند و توسط سایر ماینرها تأیید شود، بیتکوین دریافت و خواهد کرد. کارتهای گرافیک برای انجام تعداد زیادی عملیات FLOPS (عملیات ممیز شناور بر ثانیه) عالی هستند که جهت استخراج مؤثر ارزهای دیجیتال موردنیاز میباشد.

کاربردهای گرافیکی که GPU ها در آنها ایدهآل میباشند

همانطور که قبلا مشاهده شد، GPU ها در انجام محاسبات فراوان برای اندازهگیری، مکانیابی و ترسیم چندضلعیها بسیار عالی عمل میکنند. بنابراین، به طور طبیعی یکی از وظایفی که در آن برتری دارند، تولید گرافیک است. در ادامه به چند مثال و کاربردها اشاره میشود:

- رندرینگ CAD و دینامیک سیالات

- مدلسازی و انیمیشن سهبعدی

- مجازی سازی جغرافیایی

- ویرایش و پردازش ویدئو

- دستهبندی و شناسایی تصویر

بخش دیگری که به شدت از GPU ها بهرهمند شده است، حوزه مالی یا استراتژی بازار سهام میباشد. در ادامه انواع تحلیلهایی که GPU ها ممکن است در آنها بسیار مفید باشند، ذکر میگردد:

- تحلیل ریسک Portfolio

- ترندهای بازار

- کاوش دادههای بزرگ

- قیمتگذاری و ارزشگذاری

کاربردهای متعدد دیگری نیز وجود دارند که GPU ها برای آنها ایدهآل هستند:

- پردازش تصویر پزشکی

- پردازش گفتار

- پایگاه داده های رابطهای و کوئریهای موازی

- یادگیری عمیق کاربر نهایی و توسعه استراتژی بازاریابی

- شناسایی عیوب در قطعات تولیدی از طریق شناسایی تصویر

- بازیابی رمز عبور (شکستن هش)

این موارد تنها “نوک کوه یخ” در مورد آنچه GPU ها میتوانند برای کاربران انجام دهند، محسوب میشود. این صنعت در سالهای آینده گسترش بیشتری خواهد یافت.

جمع بندی: در مقایسه CPU و GPU، هر دو ارزشمند هستند

مقایسه CPU و GPU به این دلیل نیست که کدام یک برتری دارد بلکه مناسب بودن آنها برای وظایف خاص میباشد. در حوزه هوش مصنوعی، GPU ها به دلیل قابلیت پردازش موازی، برتری دارند که آنها را برای آموزش مدلهای یادگیری عمیق عالی میسازند. در مقابل، CPU ها همچنان ستون فقرات پلتفرمهای میزبانی وب باقی میمانند و چند منظوره بودن و عملکرد تکرشتهای لازم برای مدیریت حجمهای کاری متنوع و پویا را فراهم میکنند.

بهرهگیری از نقاط قوت هر یک برای مقابله با چالشهای محاسباتی پیچیده و متنوع، کلید موفقیت محسوب میشود. با پیشرفت فناوری، راهحلهای ترکیبی که قدرت CPU ها، GPU ها و فناوریهای نوظهور را ترکیب میکنند، موج بعدی نوآوری را هدایت خواهند کرد. آنها می توانند پلتفرمهای هوش مصنوعی و میزبانی وب را به سمت اوج جدیدی از عملکرد و کارایی سوق دهند.